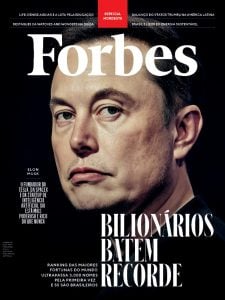

Quase 21% das imagens foram vistas 200 ou mais vezes na internet antes da publicação de determinado artigo. (iStock)

Em um mundo saturado de imagens como o que estamos vivendo hoje pode ser difícil imaginar que, no passado, as palavras eram quase que exclusivamente a maneira de descrever eventos mundiais. Os jornais daquela época eram principalmente textuais, com poucas – e estranhas – ilustrações espalhadas pelas páginas.

VEJA TAMBÉM: Fotografias feitas por drones revelam o racismo na arquitetura sul-africana

Hoje, a priorização de conteúdo rico em imagens pelos algoritmos de grandes agregadores e plataformas de redes sociais obriga toda e qualquer notícia a ser amplamente ilustrada. É difícil até saber quando uma imagem de determinado acontecimento é inédita ou quando é uma foto comprada por seu apelo visual.

No último um ano e meio, a base de dados global GDELT Project tem analisado as imagens do jornalismo online do mundo todo, a partir da seleção aleatória de 750 mil fotos de artigos diários de todos os países do mundo em 65 idiomas. Em seguida, essas imagens são processadas por meio da ferramenta do Google Cloud Vision API, para examinar as narrativas visuais do jornalismo mundial. Até então, mais de 300 milhões de imagens já passaram pelo processamento, criando um dos maiores e mais ricos catálogos do mundo sobre como os portais de notícia retratam a dimensão visual dos eventos globais.

No último mês de março, o Cloud Vision API ganhou uma nova capacidade, batizada de Web Detect, pela qual é possível realizar uma busca reversa de imagens no Google para determinar quantas vezes uma determinada foto foi vista em qualquer lugar da internet. Isso significa que agora é possível descobrir se uma imagem é inédita ou se é de banco de fotos.

Vamos usar como exemplo um mapa de imagens de notícias selecionadas aleatoriamente com a legenda “Donald Trump” nas últimas 24 horas na mídia mundial, vindas de uma variedade de países. Note que esse mapa reúne imagens com o nome “Donald Trump” mencionado na legenda e não faz nenhum tipo de análise visual, apenas pesquisa de palavras-chave em legendas, o que significa que muitas das imagens podem não mostrar de fato o presidente.

LEIA: Os melhores destinos do mundo para fotografar em 2017

Ao usar essa habilidade de contar quantas vezes uma imagem já foi vista na internet, é possível filtrar a lista de fotografias para apenas aquelas que foram publicadas em pelo menos 175 páginas da web diferentes antes de sua publicação naquele artigo das últimas 24 horas (imagens populares de bancos) ou imagens relativamente novas que foram vistas menos de 25 vezes antes de sua publicação na mesma reportagem (imagens inovadoras). Essa é uma habilidade poderosa para ordenar as narrativas visuais que definem nossa compreensão do mundo.

De 14 de março a 2 de agosto de 2017, o GDELT processou 54.336.424 imagens diferentes por meio do Cloud Vision API, capturadas de portais de notícias ao redor do mundo em 65 idiomas. Menos de um terço (30,5%) dessas imagens nunca haviam sido vistas pelo Google Images antes de sua publicação naqueles artigos, o que significa que eram, provavelmente, fotos inéditas, parte das coberturas que ilustravam. Quase metade de todas as imagens haviam sido vista em 12 ou menos páginas da web e dois terços das imagens haviam sido vistas menos de 75 vezes antes da publicação.

Esses números podem, na verdade, exagerar o número de vezes que uma imagem foi vista antes de sua publicação, pois o Google Images é extremamente rápido em indexar novas imagens e pode, às vezes, indexar algumas delas antes mesmo que o GDELT seja capaz de processá-las, o que significa que o artigo em si pode, em alguns casos, ser contado como uma aparição prévia. Além disso, muitos portais mencionam notícias relacionadas em seus artigos, o que significa que o Google Images pode detectar que a imagem apareceu em 50 páginas diferentes no site de notícias mas, na realidade, elas eram miniaturas que levavam ao artigo principal. O Cloud Vision API atualmente não faz distinção entre uma miniatura e uma aparição em tamanho cheio. Assim, é provável que a densidade real de imagens inovadoras seja maior do que um terço.

No outro extremo do espectro, quase 21% das imagens foram vistas 200 ou mais vezes na internet antes da publicação de determinado artigo (o GDELT apenas pede ao Cloud Vision API para contar até 200 ocorrências totais). Tais imagens tendem a vir de grandes bancos de fotos, como GettyImages e AP Images, e bancos de imagens, como iStock e Shutterstock, e são retratos icônicos que estão ali para definir um evento de forma visualmente apelativa ou imagens conceito utilizadas para ilustrar os principais tópicos.

E MAIS: Fotógrafo irlandês vende foto de batata por 1 milhão de dólares

As pessoas podem se perguntar por que é importante saber se os portais de notícia usam fotografias inovadoras para documentar suas notícias ou recursos de bancos de imagens. A resposta é que as imagens de bancos podem apenas transmitir o que já aconteceu – e não o que está acontecendo atualmente. Elas podem apresentar o contexto histórico e adicionar um pouco de interesse visual a um artigo, mas não podem contribuir para o entendimento, em tempo real, de como um evento está ocorrendo. Um artigo sobre as enchentes do furacão Irma que simplesmente reutiliza imagens de bancos de enchentes durante o Andrew podem ser utilizadas para entender a destruição potencial, mas não retrata como é o nível atual de devastação.

Ao considerar tudo isso, concluímos que quase um terço das fotos que acompanham as notícias online publicadas todos os dias em todo o mundo são realmente inovadoras, enquanto cerca de metade delas foi vista apenas algumas vezes, enquanto um quarto são de bancos de imagens. Isso significa que, no mínimo, 30% de todas as imagens de notícias que consumimos não acrescenta realmente nenhuma informação nova – estão lá apenas para ilustrar. Em um tempo em que cada vez mais nos voltamos às imagens para entender eventos globais, essas ferramentas de detecção de similaridade oferecem uma nova e poderosa lente para a verificação das fotografias e monitoramento de como narrativas visuais se espalham pelo ecossistema da mídia global.