A OpenAI, dona do aplicativo de inteligência artificial generativa ChatGPT, anunciou a criação de uma área que vai monitorar e calcular os riscos envolvendo o desenvolvimento da inteligência IA. De acordo com a empresa, serão direcionados 20% de seus esforços para evitar que a tecnologia se torne “desonesta, antiética e perigosa”.

Leia também:

- 5 bilionários da tecnologia que só falam de inteligência artificial

- Os 15 maiores riscos da inteligência artificial

- A IA deixará os seres humanos inúteis?

“Não existe nada, neste momento, que impeça uma eventual superinteligência de tornar-se desonesta”, diz a empresa reforçando que ainda são necessários avanços cientistas e técnicos para lidar de forma rápida com os eventuais desafios que possam surgir. A nova área será liderada por Jan Leike, pesquisador de machine learning da OpenAI e Ilya Stskeyer, cofundador da empresa.

“Nosso objetivo é que nossas tecnologias evoluam de tal forma que possamos aprender mais sobre os desafios que ela traz. É provável que criemos áreas de monitoramento e pesquisa totalmente novas.” Em vários momentos, Sam Altman, CEO da OpenAI, destacou a importância de analisar e monitorar os riscos envolvidos na evolução da IA.

Quais os riscos associados à IA?

O avanço acelerado do ChatGPT nos últimos meses e a corrida da indústria da tecnologia para quem sai na frente no uso das ferramentas de inteligência artificial protagonizaram um momento histórico em março. Uma carta aberta, assinada por mais de 2 mil cientistas, empresários de tecnologia e representantes do meio acadêmico pede que os experimentos com IA sejam pausados.

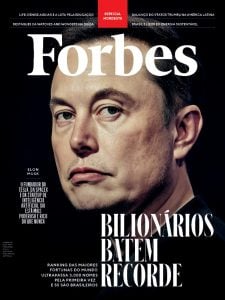

O documento com o título “pause experimentos de IA: carta aberta” leva as assinaturas de bilionários do Vale do Silício como Elon Musk, Steve Wozniak, instituições de Oxford, Cambridge, Stanford, Columbia, além de empresas como Google, Microsoft, Amazon e até o historiador Yuval Noah Harari.

“Os sistemas de IA com inteligência competitiva humana podem representar riscos profundos para a sociedade e a humanidade, conforme demonstrado por extensa pesquisa e reconhecido pelos principais laboratórios de IA. Conforme declarado nos amplamente endossados Princípios de IA de Asilomar , a IA avançada pode representar uma mudança profunda na história da vida na Terra e deve ser planejada e gerenciada com cuidados e recursos proporcionais. Infelizmente, esse nível de planejamento e gerenciamento não está acontecendo, embora os últimos meses tenham visto laboratórios de IA travados em uma corrida descontrolada para desenvolver e implantar mentes digitais cada vez mais poderosas que ninguém – nem mesmo seus criadores – pode entender, prever ou controlar de forma confiável.”

Competição com humanos

“Os sistemas contemporâneos de IA estão se tornando competitivos para humanos em tarefas gerais e devemos nos perguntar: podemos deixar que as máquinas inundem nossos canais de informação com propaganda e falsidade? Devemos automatizar todos os trabalhos, incluindo os satisfatórios? Deveríamos desenvolver mentes não-humanas que eventualmente nos superassem em número, fossem mais espertas, obsoletas e nos substituíssem? Devemos arriscar perder o controle de nossa civilização? Tais decisões não devem ser delegadas a líderes tecnológicos não eleitos. Sistemas poderosos de IA devem ser desenvolvidos apenas quando estivermos confiantes de que seus efeitos serão positivos e seus riscos serão administráveis. Essa confiança deve ser bem justificada e aumentar com a magnitude dos efeitos potenciais de um sistema”

OpenAI e a necessidade de uma revisão independente

“A declaração recente da OpenAI sobre inteligência artificial geral afirma que ‘em algum momento, pode ser importante obter uma revisão independente antes de começar a treinar sistemas futuros e para os esforços mais avançados concordar em limitar a taxa de crescimento da computação usada para criar novos modelos’, nós concordamos. Esse ponto é agora. Portanto, pedimos a todos os laboratórios de IA que parem imediatamente por pelo menos 6 meses o treinamento de sistemas de IA mais poderosos que o GPT-4 . Essa pausa deve ser pública e verificável e incluir todos os principais atores. Se tal pausa não puder ser decretada rapidamente, os governos devem intervir e instituir uma moratória.”

Leia também:

Por que pausar e como proceder?

“Laboratórios de IA e especialistas independentes devem usar essa pausa para desenvolver e implementar em conjunto um conjunto de protocolos de segurança compartilhados para design e desenvolvimento avançados de IA que são rigorosamente auditados e supervisionados por especialistas externos independentes. Esses protocolos devem garantir que os sistemas que aderem a eles sejam seguros além de qualquer dúvida razoável. Isso não significa uma pausa no desenvolvimento da IA em geral, apenas um retrocesso na corrida perigosa para modelos de caixa preta cada vez maiores e imprevisíveis com capacidades emergentes. A pesquisa e o desenvolvimento de IA devem ser reorientados para tornar os sistemas avançados e poderosos de hoje mais precisos, seguros, interpretáveis, transparentes, robustos, alinhados, confiáveis e leais.”

Governança e transparência

“Paralelamente, os desenvolvedores de IA devem trabalhar com os formuladores de políticas para acelerar drasticamente o desenvolvimento de sistemas robustos de governança de IA. Estes devem incluir, no mínimo: autoridades reguladoras novas e capazes dedicadas à IA; supervisão e rastreamento de sistemas de IA altamente capazes e grandes conjuntos de capacidade computacional; sistemas de proveniência e marca d’água para ajudar a distinguir o real do sintético e rastrear vazamentos de modelos; um ecossistema robusto de auditoria e certificação; responsabilidade por danos causados pela IA; financiamento público robusto para pesquisa técnica de segurança de IA; e instituições com bons recursos para lidar com as dramáticas perturbações econômicas e políticas (especialmente para a democracia) que a IA causará.”