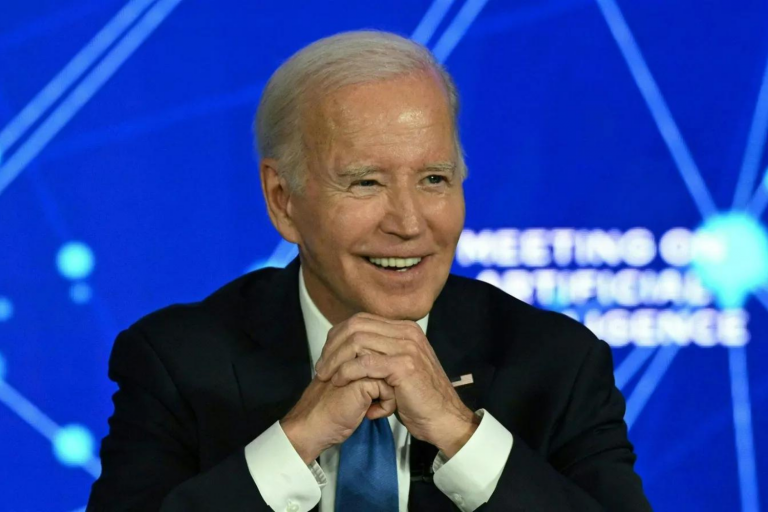

O presidente Joe Biden assinou uma nova ordem executiva abrangente nesta segunda-feira (6) para colocar barreiras no uso e desenvolvimento de IA, incluindo grandes modelos, como o GPT-5, da OpenAI, que estarão sujeitos à supervisão antes de serem lançados. As empresas de tecnologia estão aplaudindo amplamente o novo regulamento anunciado por Biden, que procura reger a forma como o governo federal utilizará a IA e estabelecer diretrizes para as empresas que constroem novos modelos.

-

Siga a Forbes no WhatsApp e receba as principais notícias sobre negócios, carreira, tecnologia e estilo de vida

O presidente dos Estados Unidos descreveu como a ordem executiva foi concebida para mitigar os riscos da IA, ao mesmo tempo que aproveita os seus benefícios, para jornalistas e legisladores no início da semana na Casa Branca. “Estou determinado a fazer tudo o que estiver ao meu alcance para promover e exigir inovação responsável”, disse Biden, chamando a IA de “a tecnologia mais importante do nosso tempo”.

Como parte da nova ordem executiva, qualquer modelo de IA que possa representar um risco para a segurança nacional deve ser divulgado ao governo. Além de partilhar dados sobre o que será feito para protegê-lo, de acordo com as normas federais a serem desenvolvidas pelo Instituto Nacional de Patentes e Tecnologia. O decreto para compartilhar dados de testes de pré-lançamento se aplica apenas a modelos que ainda não foram lançados – o que incluiria o GPT-5, o tão esperado sucessor do imensamente popular GPT-4.

Leia também:

- Como funciona a nova ferramenta de busca por IA do Google Brasil

- Lista Forbes: quem são os líderes que estão desenhando o futuro do trabalho

- Guru do marketing e CMO global da Mastercard fala sobre a “grande onda” da IA

“As empresas devem informar o governo sobre os sistemas de IA em grande escala que estão desenvolvendo e compartilhar resultados rigorosos de testes independentes para provar que não representam nenhum risco para a segurança nacional ou para a segurança do povo americano”, afirmou Biden.

Ben Buchanan, conselheiro especial de IA da Casa Branca, disse à Forbes que os modelos atualmente em uso, como o GPT-4 ou o Bard, ainda estão sujeitos a outros elementos da lei, incluindo “disposições de equidade, discriminação, proteção dos consumidores e trabalhadores”, disse ele.

A ordem também visa iniciar uma campanha de contratações de trabalhadores especialistas em IA para o governo federal. Além disso, Buchanan diz que reduzirá as barreiras para trabalhadores imigrantes no setor.

Respondendo aos receios de que a IA possa ser utilizada para discriminar cidadãos, atingir infra-estruturas críticas ou ser utilizada em guerra, a lei também exigirá que grandes modelos e programas de IA sejam avaliados pelas agências federais antes de serem implementados. Os Departamentos de Defesa e de Justiça também precisarão produzir estudos que descrevam como planejam incorporar a IA em suas funções. Espera-se que algumas disposições relativas a questões de segurança entrem em vigor nos próximos 90 dias.

A ordem executiva é a tentativa mais ampla já feita pela administração Biden para criar barreiras funcionais para o desenvolvimento de inteligência artificial, ao mesmo tempo que consolida os EUA como líder na política para o setor. Desde que assumiu o cargo, em meio a promessas de reinar entre as Big Techs, a administração Biden enfrentou derrotas ao tentar cumprir outras regulamentações e teve pouco sucesso na abordagem das preocupações com a privacidade, que há muito atormentam a tecnologia.

“A razão pela qual estamos tentando criar uma abordagem tão diferenciada, mas abrangente, é porque também vemos grandes vantagens”, disse Buchanan à Forbes. “E a orientação do presidente é que podemos mitigar os riscos desta tecnologia para aproveitarmos os benefícios.”

Os líderes das startups de IA elogiaram a abordagem do governo. “Você não pode gerenciar o que não pode medir e, com esta ordem, o governo deu passos significativos para a criação de medição e supervisão de sistemas de IA por terceiros”, disse Jack Clark, cofundador e chefe de política da Anthropic, à Forbes.

“Simplificar a imigração de trabalhadores qualificados na área de IA é talvez a melhor coisa sobre isso”, disse Manu Sharma, cofundador e CEO da startup de IA Labelbox. “Ainda estamos nos primeiros dias da IA e precisamos das melhores e mais brilhantes mentes para ajudar os EUA a acelerar o ritmo da inovação.”

Alguns, no entanto, expressaram preocupação sobre como o pedido poderia ajudar os gigantes do setor, como Google e Microsoft. “É muito reconfortante que a administração Biden tenha agido tão rapidamente para priorizar a abordagem dos riscos graves e atuais em torno da IA, incluindo aqueles relacionados à proteção da segurança cibernética, da infraestrutura crítica e da segurança nacional”, disse Aidan Gomez, cofundador e CEO da Cohere. “Dito isto, devemos permanecer cautelosos para que o governo não construa um regime regulatório que consolide o poder dos titulares.”

A ordem tem amplo poder dentro do governo federal para estabelecer padrões e diretrizes para diversas agências. Por exemplo, para combater fraudes apoiadas por IA, como vídeos “deep-fake” ou chamadas geradas por voz feita por inteligência artificial, além de instruir o Departamento de Comércio a desenvolver diretrizes para que agências federais usem marcas d’água e ferramentas de autenticação de conteúdo para rotular conteúdo gerado por IA.

Ao contrário de eras tecnológicas anteriores, os líderes da IA estão ativamente envolvidos com os governos, em vez de evitarem abertamente os reguladores. O CEO da OpenAI, Sam Altman, empreendeu uma viagem global para convencer os líderes mundiais sobre a importância da tecnologia e colocar-se em posição de moldar a sua regulamentação. O CEO do Google, Sundar Pichai, vem pedindo regras de IA há anos — num artigo de opinião de 2020, no Financial Times, ele escreveu: “Agora não tenho dúvidas de que a inteligência artificial precisa ser regulamentada.”

Em declarações, Kent Walker, presidente de assuntos globais do Google, e o porta-voz da OpenAI, Elie Georges, elogiaram o governo por seu foco em aumentar o potencial da IA. Empresas como a Nvidia também já assinaram uma série de compromissos voluntários que a administração de Biden divulgou no início deste ano para garantir que os seus modelos sejam seguros e confiáveis.

A ordem executiva de Biden surge no momento em que a União Europeia se aproxima da introdução das primeiras leis de IA do mundo, que dá ao bloco a capacidade de proibir ou encerrar serviços de IA que se considerem prejudiciais à sociedade. Outros países também estão agindo para restringir o uso de IA, incluindo a Austrália, que pretende introduzir leis para proibir vídeos deepfake.