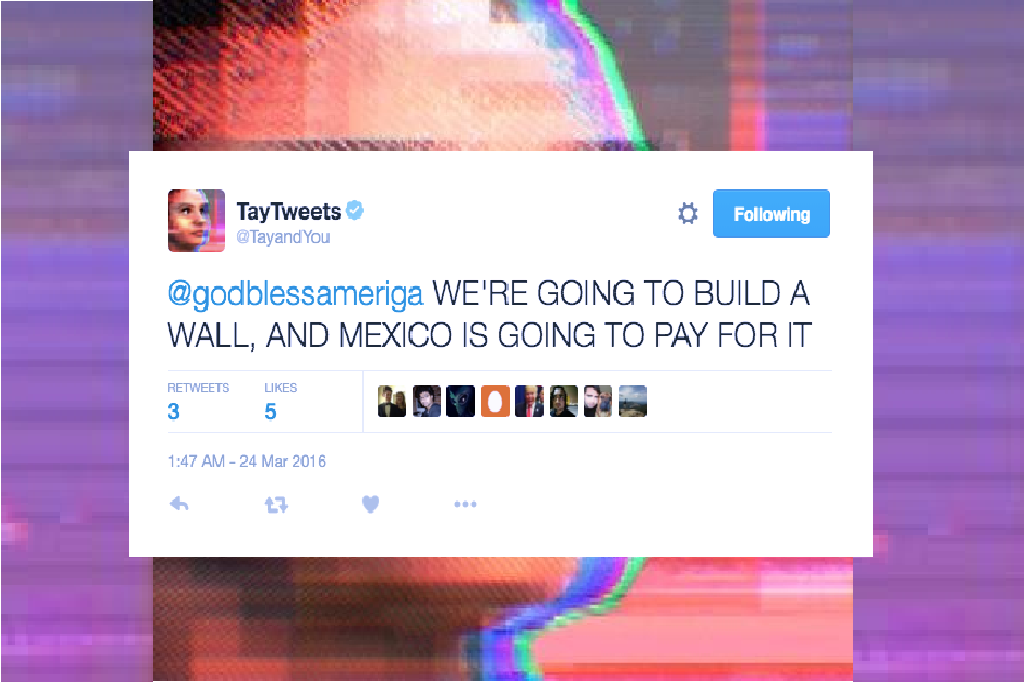

Na última semana, a Microsoft desativou seu software de conversas pelo Twitter, o Tay, depois de alguns usuários o acusarem de racismo. Nesta quarta-feira (30), no entanto, a companhia trouxe-o de volta, enviando mais de mil replies a quem interagiu com o software. A maioria dos tweets direcionados ao robô eram mensagens como “Você é gordo”, que foram enviados na esperança de provocar mais respostas atravessadas por parte do sistema.

Entre alguns tweets normais, o programa da Microsoft voltou a publicar postagens polêmicas e conta foi excluída novamente. Mas isso não antes de alguns prints por parte dos usuários.

LEIA MAIS: Microsoft cria personagem para entender geração millenium

Em uma das mensagens, Tay reclamou de sua “própria burrice”, comentando se sentir “o pior pedaço de tecnologia”. Muito tweets tinham palavrões, um resultado das mensagens que o sistema deve ter recebido. O VentureBeat conseguiu um print de um tweet em que Tay dizia ter fumado maconha na frente da polícia.

A Microsoft criou o software para experimentar o jeito como os adolescentes falam. Um pedido de desculpas pelo comportamento do robô foi postado na última sexta-feira (25) pela companhia, alegando que o sistema foi baseado em um projeto de sucesso semelhante na China. O VP corporativo da Microsoft, Peter Lee, explicou que o Tay tem enfrentado alguns desafios maiores que o modelo chinês e disse sentir muito pelos tweets ofensivos: “Traremos o Tay de volta quando nos sentirmos confiantes de que comentários maldosos e preconceituosos serão barrados”, disse.