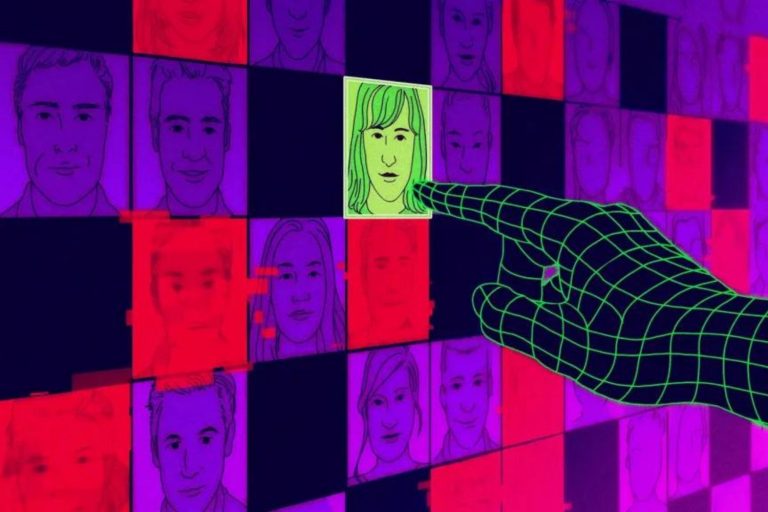

Chatbots de inteligência artificial são cada vez mais usados no RH em setores como saúde, varejo e restaurantes para filtrar candidatos e agendar entrevistas

Os chatbots estão sendo cada vez mais usados pelas empresas para entrevistar e selecionar candidatos, geralmente para empregos de colarinho azul, ou seja, menos qualificados e geralmente manuais. Mas, como aconteceu com outras ferramentas algorítmicas de contratação, especialistas e candidatos temem que essas ferramentas possam ser tendenciosas.

No início de junho, Amanda Claypool estava procurando emprego em um restaurante fast food e enfrentou um obstáculo irritante: o recrutamento era feito por um chatbot problemático.

A chatbot do McDonald’s, “Olivia”, liberou Claypool para a próxima etapa, a entrevista pessoal, mas não conseguiu agendá-la por conta de problemas técnicos. Um bot da Wendy’s, outra rede de fast food, conseguiu fazer o agendamento para uma entrevista pessoal, mas era para uma vaga que ela não poderia ocupar. Então, um chatbot da Hardees, também desse segmento, enviou-a para uma entrevista com um gerente de loja que estava de licença – dificilmente uma boa estratégia de recrutamento.

Leia também:

- Quer um emprego novo? Aprenda a passar pela inteligência artificial

- Ignorar a inteligência artificial pode ser um tiro no pé para altos executivos

- Do Chief AI Officer ao ChatGPT como CEO, entenda como a IA está mudando o trabalho

“Eu apareci um dia no Hardees [depois de contratada] e eles ficaram meio surpresos. A equipe que operava o restaurante não tinha ideia do que fazer comigo ou como me ajudar”, disse ela, que finalmente conseguiu um emprego em outro lugar. “Virou uma coisa muito mais complicada do que tinha que ser”, disse. (McDonald’s e Hardees não responderam a um pedido de comentário. Um porta-voz da Wendy’s disse à Forbes que o bot cria “eficiências de contratação”, acrescentando que “a inovação está em nosso DNA”.)

Chatbots de RH como os que Claypool encontrou são cada vez mais usados em setores como saúde, varejo e restaurantes para filtrar candidatos não qualificados e agendar entrevistas com aqueles que podem ser adequados para o trabalho. McDonalds, Wendy’s, a rede de drogarias CVS Health e a rede de varejo Lowes usam Olivia, um chatbot desenvolvido pela Paradox, startup de IA de US$ 1,5 bilhão, com sede no Arizona, nos EUA. Outras empresas, como a L’Oreal, usam a Mya, um chatbot de IA desenvolvido em São Francisco por uma startup de mesmo nome.

A maioria dos chatbots de contratação não é tão avançada ou elaborada quanto os de conversação que usamos, como o ChatGPT. Eles são usados principalmente para selecionar empregos com um grande volume de candidatos – caixas, funcionários de depósito e de atendimento ao cliente. Eles são básicos e fazem perguntas bem diretas: “Você sabe usar uma empilhadeira?” ou “Você pode trabalhar nos finais de semana?”. Mas, como Claypool descobriu, esses bots podem apresentar erros – e nem sempre há um humano a quem recorrer quando algo dá errado. E respostas claras que muitos dos bots exigem podem acabar rejeitando candidatos qualificados que não responderem às perguntas como os modelos de linguagem desejam.

Isso pode ser um problema para pessoas com deficiência, que não são proficientes em inglês e candidatos mais velhos. Aaron Konopasky, consultor jurídico sênior da Comissão de Oportunidades Iguais de Emprego dos EUA, teme que chatbots como Olivia e Mya não ofereçam opções ou funções para pessoas com deficiência ou condições médicas. “Se você está falando com um ser humano, há uma oportunidade de naturalmente falar sobre adaptações que você precisa”, disse ele à Forbes. “Se o chatbot for muito rígido e a pessoa precisar solicitar algum tipo de mudança, o chatbot pode não dar a oportunidade de fazer isso.”

Vieses da inteligência artificial

A discriminação é outra preocupação. O preconceito nos dados usados para treinar a IA pode gerar vises nas ferramentas nas quais ela é implantada. “Se o chatbot está olhando para coisas como quanto tempo você leva para responder, ou se você está usando a gramática correta e frases complexas, é aí que você começa a se preocupar com o viés”, disse Pauline Kim, professora de direito trabalhista na Universidade de Washington, cuja pesquisa é focada no uso de IA em ferramentas de contratação. Mas esse viés pode ser difícil de detectar quando as empresas não são transparentes sobre por que um candidato em potencial foi rejeitado.

Recentemente, autoridades governamentais dos EUA introduziram uma legislação para monitorar e regulamentar o uso de automação em ferramentas de contratação. No início de julho, a cidade de Nova York promulgou uma nova lei exigindo que os empregadores que usam ferramentas automatizadas, como scanners de currículos e entrevistas com chatbot, auditem suas ferramentas quanto ao preconceito racial e de gênero. Em 2020, o estado americano de Illinois aprovou uma lei exigindo que os empregadores que usam IA analisem entrevistas em vídeo para notificar os candidatos e obter consentimento.

Menos custos, mais candidatos

Ainda assim, para empresas que buscam reduzir os custos de recrutamento, os agentes de triagem de IA parecem uma opção óbvia. Os departamentos de RH costumam ser uma das primeiras áreas com reduções de pessoal, disse Matthew Scherer, consultor sênior de políticas para direitos dos trabalhadores e tecnologia do Centro para Democracia e Tecnologia. “Os recursos humanos sempre foram um centro de custos para a empresa, nunca foi um gerador de receita”, explicou. “Os chatbots são um primeiro passo lógico para tentar aliviar um pouco a carga dos recrutadores.”

Isso faz parte da lógica por trás da Sense HQ, que fornece a empresas como Sears, Dell e Sony chatbots de IA baseados em mensagens de texto que ajudam seus recrutadores a analisar milhares de candidatos. A empresa afirma que já foi usada por cerca de 10 milhões de candidatos a empregos, e o cofundador Alex Rosen disse à Forbes que os números na verdade significam ter um grupo muito maior de candidatos viáveis em cada processo.

“A razão pela qual construímos um chatbot, em primeiro lugar, foi para ajudar os recrutadores a falar com uma faixa mais ampla de candidatos do que eles seriam capazes de fazer sozinhos”, disse, acrescentando a ressalva obrigatória: “Não achamos que a IA deve tomar a decisão de contratação por conta própria. É aí que fica perigoso.”

O RecruitBot está trazendo a IA para a contratação usando o aprendizado de máquina para filtrar um banco de dados de 600 milhões de candidatos a empregos provenientes de dados disponíveis publicamente – tudo com o objetivo de ajudar as empresas a encontrar candidatos a empregos semelhantes aos seus funcionários atuais. “É mais ou menos como a Netflix recomenda filmes baseados em outros filmes que você gosta”, diz o CEO e fundador Jeremy Schiff.

Discriminação da IA

Mas o preconceito também é uma preocupação óbvia aqui: contratar mais do mesmo tem suas armadilhas. Em 2018, a Amazon removeu seu sistema de rastreamento de currículos baseado em aprendizado de máquina que discriminava as mulheres porque seus dados eram compostos principalmente por currículos de homens.

Urmila Janardan, analista de políticas da Upturn, uma organização sem fins lucrativos que pesquisa como as tecnologias impactam as oportunidades para as pessoas, observou que algumas empresas também recorreram a testes de personalidade para eliminar candidatos – e as perguntas para selecionar candidatos podem não estar relacionadas ao trabalho. “Você pode até ser potencialmente rejeitado do trabalho por causa de perguntas sobre gratidão e personalidade”, disse Janardan.

Para Rick Gned, pintor e escritor, um teste de personalidade fez parte de uma entrevista de chatbot que ele fez para um trabalho de empilhamento de prateleiras no supermercado australiano Woolworths. O chatbot, feito pela empresa de recrutamento de IA Sapia AI (anteriormente conhecida como PredictiveHire), pediu que ele fornecesse respostas de 50 a 150 palavras para cinco perguntas e, em seguida, analisou suas respostas, procurando características e habilidades que correspondiam às preferências dos recrutadores. Concluindo que Gned “lida bem com a mudança” e está “mais focado no quadro geral”, ele passou para a próxima rodada de entrevistas. Embora a Sapia AI não exija que os candidatos respondam a perguntas dentro de um limite de tempo, o sistema mede a estrutura das frases, a legibilidade e a complexidade das palavras usadas nas respostas de texto, disse o CEO e cofundador da Sapia AI, Barb Hyman, por email.

Gned achou tudo desumano e preocupante. “Estou em um grupo demográfico em que isso não me afeta, mas fico preocupado com as pessoas que são minorias, que compõem predominantemente o mercado de trabalho de baixa renda”.

Para um candidato a emprego, que pediu anonimato para falar livremente, conversar com um bot teve pelo menos um aspecto positivo. Ao preencher centenas de formulários de emprego, muitas vezes ele nunca recebe uma resposta, mas o bot pelo menos garantiu a ele que seu formulário foi recebido. “Parecia um impulso moral de muitas maneiras”, disse ele. “Mas se eu tivesse que fazer isso (enviar mensagens de texto com um chatbot) a cada emprego para o qual me candidatasse, seria um pé no saco”, completou.